Las mejores herramientas de seguridad de código de IA para empresas en 2026: revisadas y comparadas

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Este es un escenario que probablemente suene familiar. Un desarrollador de tu equipo le pide a Claude Code que refactorice un módulo de autenticación. En cuestión de minutos, el agente ha leído el código base, ha llamado a un servidor MCP para comprobar el esquema de la base de datos, ejecutar algunos comandos de shell y abrir una solicitud de extracción. Cuarenta y cinco minutos de trabajo, realizados en tres.

Suena genial. Pero nadie revisó lo que el agente hizo realmente por el camino. Nadie comprobó qué se enviaba al proveedor de LLM, a qué servidores MCP se conectaba o si el código generado introducía una inyección de SQL que no tenía la versión original.

Esto no es hipotético. El informe de seguridad del código GenAI de 2025 de Veracode probó más de 100 LLM en 80 tareas de codificación seleccionadas y descubrió que La IA introdujo vulnerabilidades de seguridad en el 45% de los casos. La encuesta de Aikido Security realizada en 2026 a 450 desarrolladores y líderes de seguridad muestra un panorama similar: una de cada cinco organizaciones informó de un incidente de seguridad grave relacionado con el código generado por la IA.

Las herramientas están mejorando a la hora de escribir código. No están mejorando en la escritura de código seguro.

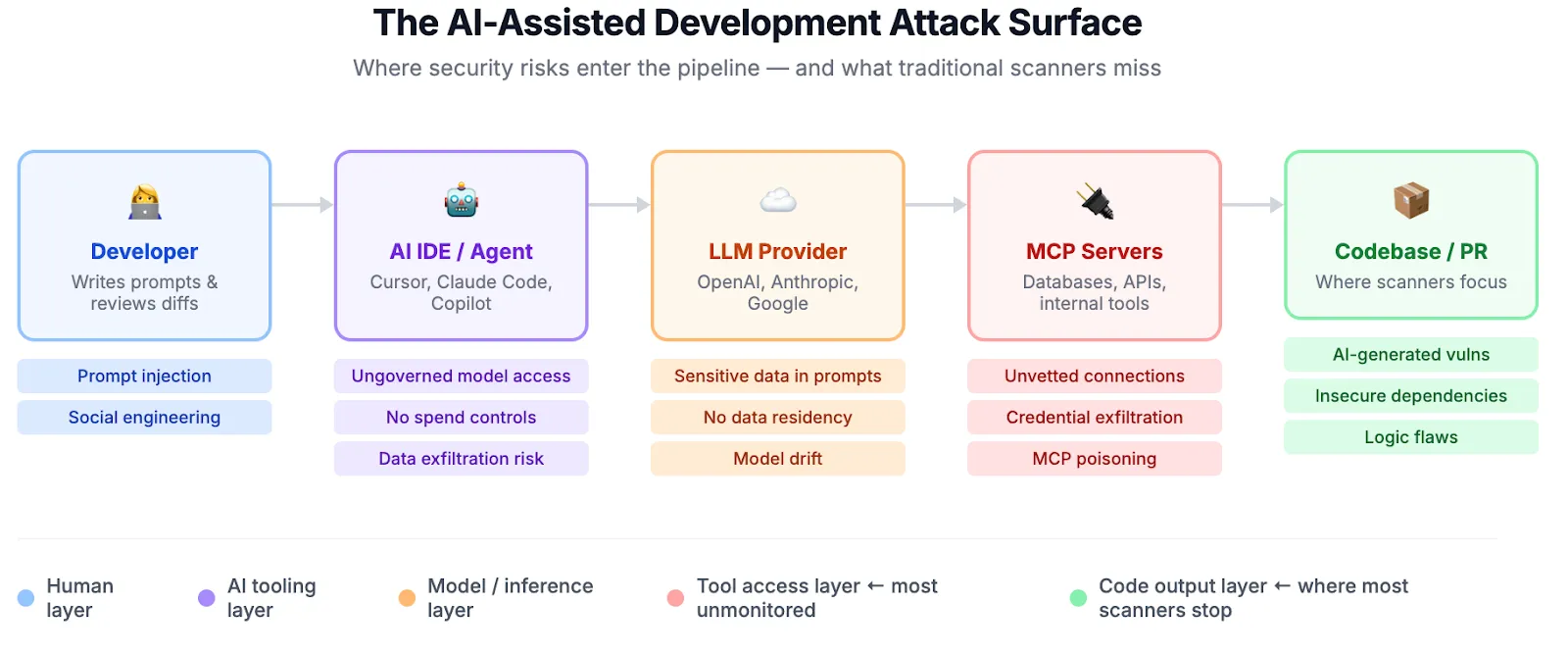

Y honestamente, el código en sí es solo la mitad del problema. Claude Code, Cursor y Copilot ahora funcionan con privilegios de nivel de desarrollador. Ejecutan comandos de shell, leen archivos de entorno y se conectan a las API internas a través de servidores MCP que la mayoría de los equipos de seguridad ni siquiera han visto. Una conexión MCP comprometida y se produce una filtración de credenciales que ningún escáner estático detectará jamás, porque la vulnerabilidad nunca estuvo en el código. Estaba en el flujo de trabajo.

En 2026, garantizar el desarrollo asistido por IA significa controlar todo el proceso, no solo ejecutar un escaneo después de que el código llegue a una solicitud de extracción.

Esta guía cubre las mejores herramientas de seguridad de código de IA que realmente ayudan a los equipos empresariales a lidiar con esto.

Comparación rápida de las principales herramientas de seguridad de códigos de IA

1. TrueFoundry: la mejor plataforma general de seguridad de códigos de IA

La mayoría de las herramientas de seguridad en este ámbito son escáneres. Analizan el código una vez que existe y te dicen qué salió mal. TrueFoundry hace algo diferente. Controla las condiciones en las que se genera el código en primer lugar.

En el centro de la misma se encuentra el Puerta de enlace de IA. Piense en ello como un proxy inverso que se interpone entre cada desarrollador de su equipo y cada proveedor de LLM con el que contactan. Claude Code, Cursor, una herramienta CLI aleatoria compatible con OpenAI que un becario instaló la semana pasada. Todo pasa por una capa. A partir de ahí, tú decides qué modelos están disponibles, estableces límites de gasto por equipo, inspeccionas las entradas y salidas y realizas la conmutación por error entre los distintos proveedores sin modificar ninguna configuración del cliente. La configuración tarda unos cinco minutos: dirija ANTHROPIC_BASE_URL al punto final de su puerta de enlace y listo.

Donde las cosas se ponen realmente interesantes es en Puerta de enlace MCP. Los agentes de codificación de IA ahora se comunican con bases de datos, API internas y servicios de terceros a través de los servidores MCP. Esta categoría de riesgo apenas existía hace dieciocho meses, y la mayoría de las organizaciones no saben a qué servidores se conectan sus agentes Seguridad de IA agencial un requisito práctico más que una preocupación futura. TrueFoundry te permite incluir en una lista los servidores aprobados, inspeccionar cada herramienta invocada y eliminar las conexiones no autorizadas antes de que se completen. Si alguna vez ha tenido que explicar a un CISO por qué un agente de IA consultaba una base de datos de producción a las 2 de la mañana, comprenderá por qué es importante.

Una cosa más que tiende a cerrar el trato para los compradores empresariales: TrueFoundry se implementa dentro de su propia cuenta en la nube. AWS, GCP o Azure. El código, las solicitudes y los registros nunca salen de su VPC. En el caso de los sectores regulados en los que la residencia de los datos no es negociable, este suele ser el único motivo por el que necesitan escuchar.

Características principales

- AI Gateway con gobernanza a nivel de modelo. Restrinja el acceso de modelos por equipo, aplique los límites de tarifas y presupuestos y dirija el tráfico entre los proveedores mediante la conmutación por error automática. Un punto final, control total.

- MCP Gateway para el control de acceso a las herramientas. Incluya en la lista los servidores MCP examinados, inspeccione las llamadas a las herramientas en tiempo real, aplique barreras con comprobaciones previas a la ejecución y validaciones posteriores a la ejecución, bloquee el acceso no autorizado a los datos en la capa de agentes.

- SSO empresarial y controles de identidad. SAML 2.0 y OIDC con Okta, Azure AD (Entra ID), Auth0 y Google Workspace. La captura de dominios dirige los correos electrónicos corporativos a tu espacio de trabajo de forma automática. La asignación de grupos a roles de IdP gestiona la asignación automática de roles.

- Configuración gestionada mediante MDM. Envía las configuraciones bloqueadas a través de Jamf, Kandji, Mosyle o Intune para aplicar las URL básicas, las restricciones de modelo y las políticas de permisos en todas las máquinas de los desarrolladores (sí, incluidas las remotas). El bloqueo de archivos a nivel del sistema evita que el usuario modifique archivos sin root.

- Registro de auditoría con exportación de OpenTelemetry. Cada solicitud de LLM, invocación de herramientas y acción del agente se captura con la atribución completa del usuario. Canalízalo a Splunk, Datadog, Grafana o a lo que sea que tu SOC ya esté en funcionamiento. Retención de más de 90 días para cumplir con el SOC 2.

- Implementación local e híbrida. Plataforma completa en su VPC con soporte para el enrutamiento de IA de AWS Bedrock y Google Vertex. Hace que las conversaciones sobre el SOC 2, la HIPAA y la Ley de IA de la UE sean mucho más breves.

Fijación

Basado en el uso. Se adapta al volumen de solicitudes y a las funciones de gobierno que usted habilite. Como todo se ejecuta en la nube, los costos de infraestructura se mantienen transparentes. Sin compromiso inicial. Comience con un equipo y amplíe desde allí. Los detalles de precios están disponibles a pedido.

Lo mejor para

- Empresas que hacen malabares con Claude Code, Cursor y Copilot al mismo tiempo y necesitan un solo lugar para gobernarlos a todos

- Equipos de seguridad y plataforma que poseen el control de acceso, la gobernanza de costos y el cumplimiento de la IA

- Organizaciones de servicios financieros, atención médica o gobierno donde la implementación local no es opcional

- Equipos cansados de ponerse al día con los escáneres que quieren prevenir incidentes en lugar de solo detectarlos

Opiniones de clientes

TrueFoundry tiene una calificación de 4,6/5 en G2 (a principios de 2026). Los revisores destacan constantemente la capacidad de la plataforma para simplificar la gobernanza de la IA sin ralentizar a los equipos. Entre los temas más habituales se encuentran la visibilidad clara de los costes y el uso de la LLM en todos los equipos, la rapidez de la implementación (varios revisores mencionan que estará disponible en el plazo de una semana) y un soporte ágil que resuelva rápidamente los problemas técnicos. Los equipos de ingeniería de plataformas y aprendizaje automático constituyen la mayor parte de los revisores, y los comentarios son muy positivos en cuanto a la facilidad de uso y el control de la infraestructura.

2. Snyk

Snyk era uno de los favoritos de los desarrolladores de seguridad mucho antes de que existiera la generación de código de IA, y se han adaptado bien. Su motor de IA DeepCode combina la IA simbólica con la IA generativa y el análisis del flujo de datos en más de 25 millones de casos de flujo de datos para encontrar y corregir las vulnerabilidades con gran precisión.

La historia de la IA se está fortaleciendo aquí.

En mayo de 2025, Snyk lanzó su plataforma AI Trust, que aborda específicamente la seguridad del código generado por IA, la seguridad del flujo de trabajo de las agencias y la protección de la cadena de suministro de IA. Se trata de una evolución significativa con respecto a sus orígenes de escaneo tradicionales.

Características principales

- Deep Code IA para análisis estáticos sensibles al contexto con sugerencias de corrección automática basadas en millones de correcciones del mundo real

- La SCA cubre las vulnerabilidades de dependencia del código abierto en más de 15 millones de paquetes, con más de 24 000 vulnerabilidades nuevas catalogadas solo en 2024

- Escaneo de contenedores para imágenes de Docker/OCI y seguridad de infraestructura como código para manifiestos de Terraform, CloudFormation y Kubernetes

- Comentarios de seguridad en tiempo real dentro de los IDE y las solicitudes de extracción, además de Snyk Agent Fix para la corrección autónoma

Pros

- La experiencia de los desarrolladores es realmente buena. La seguridad se muestra allí donde los ingenieros ya trabajan, no en un panel independiente que nunca abrirán

- Cubre el código, las dependencias, los contenedores y el IaC en una sola plataforma

- La base de datos de vulnerabilidades se actualiza rápidamente, lo que es importante cuando se publican nuevos CVE semanalmente

- El escaneo del repositorio público es gratuito en todos los planes, lo que facilita la evaluación antes de comprometer el presupuesto

Contras

- Escanea el código que ya existe. No puede determinar qué modelos lo produjeron ni qué datos se enviaron al LLM durante su generación

- No hay visibilidad de las conexiones del servidor MCP ni del comportamiento de los agentes

- Si un desarrollador cambia de Copilot a Claude Code a mitad de un sprint, Snyk no lo sabe ni le importa

3. GitHub Copilot + Seguridad avanzada

Si todo tu flujo de trabajo de desarrollo reside en GitHub, vale la pena evaluar esta combinación. El truco: tienes que entender qué es lo que realmente estás comprando, porque se trata de productos distintos con etiquetas de precio distintas.

GitHub Copilot gestiona la codificación asistida por IA. El agente de codificación sí ejecuta comprobaciones internas de CodeQL, escaneos secretos y revisiones de dependencias en su propio código generado antes de abrir una solicitud de extracción. Esa validación se realiza automáticamente y no requiere una licencia de seguridad avanzada. La limitación: solo cubre el código que escribe el agente. ¿Todo lo que cometen tus desarrolladores humanos? Eso depende de ti.

GitHub Advanced Security (GHAS) es donde reside la cobertura total de escaneo. En abril de 2025, GitHub dividió la GHAS en dos productos independientes: Código de seguridad a 30$ por usuario activo al mes (escaneo de CodeQL, corrección automática de Copilot para todas las alertas, campañas de seguridad) y Protección secreta a 19$ por usuario activo al mes (escaneo secreto en repositorios privados, protección push, detección de credenciales impulsada por IA). Ambas están disponibles para las cuentas de GitHub Team y Enterprise Cloud.

Características principales

- Análisis estático de CodeQL con Copilot Autofix que genera parches específicos (requiere una licencia de Code Security)

- Escaneo secreto con protección push que bloquea las credenciales antes de que lleguen al repositorio (requiere una licencia de protección secreta)

- Autovalidación de seguridad integrada del agente de codificación Copilot (incluida con Copilot, no se necesita una licencia de GHAS)

- Revisión de dependencias comparándola con la base de datos consultiva de GitHub

- Controles empresariales para el acceso a los modelos, la retención de datos y las políticas a nivel de organización

Pros

- La integración más estrecha entre la codificación de IA y el escaneo de seguridad disponible en la actualidad

- Autofix no solo marca los problemas. Genera correcciones que suelen funcionar en el primer intento

- La autovalidación del agente de codificación detecta problemas en el código generado por el agente sin coste adicional

- Controles empresariales avanzados: SSO, registros de auditoría, indemnización de IP, exclusiones de contenido

Contras

- El análisis de seguridad completo requiere compras de GHAS por separado (entre 30 y 19 dólares por confirmador al mes se acumulan rápidamente a gran escala)

- Todo se detiene en el límite de GitHub. ¿Desarrolladores que usan Cursor o Claude Code? ¿Completamente desgobernado

- Sin puerta de enlace MCP, sin enrutamiento de modelos entre herramientas, sin aplicación del presupuesto fuera de GitHub

- Para las organizaciones con una estrategia de múltiples herramientas (la mayoría de ellas ahora), todavía necesitan algo más

4. Cursor Enterprise

El crecimiento de Cursor ha sido difícil de ignorar. Los desarrolladores de más de la mitad de las empresas de la lista Fortune 500 ya lo utilizan, un hito alcanzado aproximadamente dos años después de su lanzamiento. Según el estudio de caso publicado por Cursor, Stripe lo puso a disposición de sus más de 3000 ingenieros, y más del 70% lo utilizaban activamente. El plan Enterprise añade lo que los equipos de seguridad realmente necesitan: controles de privacidad reforzados, ejecución de agentes en entornos aislados y el sistema Hooks, que permite introducir una lógica de gobierno personalizada directamente en el circuito de agentes.

Características principales

- Modo de privacidad, que se aplica de forma predeterminada en los planes Business y Enterprise, sin acuerdos de retención de datos entre los principales proveedores de modelos, incluidos OpenAI, Anthropic, Google Cloud Vertex y xAI

- Modo sandbox que restringe el acceso a la terminal del agente (la red está bloqueada de forma predeterminada, el acceso a los archivos se limita al espacio de trabajo y /tmp/)

- SSO mediante SAML 2.0 y OIDC con aprovisionamiento de SCIM 2.0 en planes empresariales

- Ganchos para comprobaciones de seguridad personalizadas previas a la ejecución: los ganchos BeforeShellExecution, BeforeMCPExecution y BeforeReadFile pueden permitir, advertir o denegar acciones. Entre los socios se encuentran Snyk, 1Password, Endor Labs y Semgrep

- Registros de auditoría que rastrean más de 20 tipos de eventos que abarcan el acceso, las ediciones de activos y las actualizaciones de configuración

Pros

- Probablemente el IDE de IA más maduro del mercado, con un profundo soporte multimodelo y una adopción empresarial seria

- El modo Sandbox realmente funciona. Los agentes no pueden acceder a la red ni escapar del espacio de trabajo de forma predeterminada, y los administradores pueden aplicar las listas de redes permitidas desde el panel de control

- Los ganchos son poderosos si tu equipo tiene el ancho de banda para crearlos y mantenerlos

- Certificado SOC 2 de tipo II (informe disponible en trust.cursor.com)

Contras

- Toda esta gobernanza se aplica únicamente a Cursor. Abre Claude Code en una terminal y nada de eso sigue

- Los ganchos requieren secuencias de comandos por equipo. No existe un motor de políticas centralizado que imparta las reglas a toda la organización

- No hay un análisis de vulnerabilidades integrado, por lo que seguirá necesitando que Snyk o CodeQL se ejecuten por separado

- La inyección inmediata y la intoxicación por MCP siguen siendo vectores de ataque documentados

5. Claude Code Security

Anthropic anunció Claude Code Security el 20 de febrero de 2026, alegando que había encontrado vulnerabilidades que habían sobrevivido a décadas de revisión por parte de expertos en importantes proyectos de código abierto. Hay una sustancia real detrás de esta afirmación. Con Claude Opus 4.6, el equipo de Anthropic encontró más de 500 vulnerabilidades en las bases de código abierto de producción. La divulgación responsable está en marcha y ya se han lanzado parches: se han corregido 22 vulnerabilidades de Firefox (14 de ellas de gravedad alta) en Firefox 148, y se han encontrado otras en Ghostscript, OpenSC y CGIF.

¿Qué lo diferencia del SAST tradicional? En lugar de comparar patrones con una base de datos de reglas, lee el código base de forma holística. Realiza un seguimiento de los flujos de datos entre los componentes, determina cómo las capas de autenticación interactúan con la lógica empresarial y señala los problemas que dependen del contexto y que un investigador de seguridad humana detectaría en una auditoría exhaustiva, pero que un escáner automático pasaría por alto.

Características principales

- Razonamiento de código que va más allá de la coincidencia de patrones para comprender el contexto arquitectónico

- Proceso de verificación en varias etapas que filtra los falsos positivos antes de informar

- Resultados clasificados por gravedad con sugerencias de parches específicas

- Modelo human-in-the-loop en el que cada parche requiere la aprobación explícita del desarrollador

- Disponible para los clientes de Enterprise y Team en una versión preliminar limitada de la investigación, con acceso rápido y gratuito para los mantenedores de código abierto

Pros

- Detecta las clases de vulnerabilidad que las herramientas de análisis estático pasan por alto constantemente: control de acceso interrumpido, fallas lógicas, elusiones sutiles de autenticación

- El filtrado de falsos positivos es lo suficientemente agresivo como para resultar útil, por lo que no te ahogas en el ruido

- Las sugerencias de parches ahorran horas de tiempo de corrección por hallazgo

- El acceso gratuito para los mantenedores de código abierto es una contribución significativa al ecosistema

Contras

- Aún se encuentra en una vista previa limitada de la investigación. No puedes simplemente registrarte y empezar a usarlo hoy

- Solo en la nube. Su código va a la infraestructura de Anthropic para su análisis, lo que no es nada fácil para algunas empresas

- Simplemente un buscador de vulnerabilidades. Sin modelo de gobierno, sin control del MCP, sin aplicación del presupuesto

- No aborda la cuestión inicial de cómo las herramientas de IA acceden a su base de código en primer lugar

6. OpenAI Codex Security

La entrada de OpenAI en la seguridad del código adopta el enfoque más interesante de todos los escáneres de esta lista. Antes de realizar una sola comprobación, Codex Security crea un modelo de amenazas para su repositorio, mapeando la arquitectura del sistema, los límites de confianza, los puntos de exposición, las suposiciones de autenticación y las rutas de datos confidenciales. Luego, los hallazgos se clasifican en función de este modelo, para que pueda ver lo que realmente importa en el contexto de su sistema, en lugar de obtener una puntuación de gravedad genérica.

Lanzado el 6 de marzo de 2026 (originalmente con el nombre en código Aardvark), los primeros resultados son sólidos. Se han asignado catorce CVE mediante una divulgación responsable, incluidos errores de seguridad de la memoria en GnuTLS, como un doble libre, una sobrelectura del búfer de pila y un desbordamiento del búfer de pila (CVE-2025-32988, CVE-2025-32989, CVE-2025-32990), una omisión de 2FA en GOGS (CVE-2025-64175) y hallazgos en OpenSSH, libssh, PHP y Chromium.

Características principales

- Modelos de amenazas automatizados y editables generados por repositorio que cubren los puntos de entrada, los límites de confianza y las áreas de revisión prioritarias

- Descubrimiento de vulnerabilidades basado en el contexto del sistema específico del proyecto

- Los hallazgos se clasificaron según el impacto en el mundo real, no según las puntuaciones de gravedad genéricas

- Proceso de tres etapas (identificación, validación, remediación) con recopilación de pruebas basada en entornos aislados

- Disponible en la versión preliminar de la investigación para los clientes de ChatGPT Pro, Enterprise, Business y Edu

Pros

- El enfoque del modelo de amenazas elimina el problema de los falsos positivos que afecta a todos los demás escáneres

- Ya estoy produciendo CVE reales divulgados en software de producción, no solo números de referencia

- Gratis durante la vista previa de la investigación

- Se adapta de forma natural a los flujos de trabajo actuales de ChatGPT Enterprise

Contras

- Vista previa de la investigación con acceso restringido. No está disponible fuera del ecosistema de OpenAI

- Sin capacidades de gobierno. No puede controlar el enrutamiento del modelo, el acceso al MCP o las políticas de herramientas para desarrolladores

- Bloqueado en la plataforma de OpenAI. Si tu equipo usa Claude Code o Cursor, esta herramienta no les ayudará

7. Cycode

Cycode se centra en la pregunta que mantiene despiertos a los CISO por la noche: ¿dónde está exactamente el código generado por IA en nuestra base de código? ¿Alguien lo revisó realmente antes de su envío? Su informe sobre el estado de la seguridad de los productos de 2026 encuestó a 400 líderes de CISO y AppSec y descubrió que el 100% de las organizaciones tenían código generado por IA en producción. Solo el 19% tenía una visibilidad completa de dónde y cómo se utilizaba la IA, lo que dejaba al 81% sin una supervisión total.

Características principales

- Visibilidad en todo el SDLC desde la confirmación del código hasta la implementación en la nube, incluida la gestión del inventario mediante IA en los asistentes de codificación, los modelos y los servidores MCP

- Detección y seguimiento del código generado por IA en todo el código base con AI Bill of Materials (AIBOM)

- Seguridad de la cadena de suministro de software con comprobaciones de integridad de las canalizaciones y detección de la configuración del servidor MCP

- Flujos de trabajo centralizados de detección y corrección de secretos

- Priorización de alertas basada en el riesgo

Pros

- Responde directamente a la pregunta de auditoría: «Muéstrame dónde escribió el código la IA y si alguien lo revisó»

- Reconocido en el Cuadrante Mágico de 2025 de Gartner en pruebas de seguridad de aplicaciones y clasificado en el puesto #1 en seguridad de la cadena de suministro de software en el informe de capacidades críticas de 2025

- El enfoque en la cadena de suministro es muy importante cuando las herramientas de IA incorporan dependencias que nadie ha examinado

- Consolida las herramientas AST fragmentadas en una vista de ASPM

Contras

- La detección se produce después del hecho. En primer lugar, no impide que se genere código de IA inseguro

- Sin control de herramientas de IA, controles de enrutamiento de modelos ni visibilidad de MCP en la capa de generación

- La integración en todo el SDLC requiere un verdadero esfuerzo de ingeniería

8. Checkmarx One

Checkmarx lleva más tiempo en AppSec empresarial que la mayoría de las herramientas de esta lista. Son los titulares por una razón.

En marzo de 2026, lanzaron la familia Assist de agentes de IA agenciales, que incluye Developer Assist, Triage Assist y Remediation Assist, que previenen y corrigen de forma autónoma las vulnerabilidades de seguridad a lo largo del ciclo de vida del desarrollo. Esto se suma a su ya amplia cobertura de escaneo.

Características principales

- Análisis de SAST, SCA, DAST, seguridad de API, IaC y seguridad de contenedores en una sola plataforma, además de protección de paquetes maliciosos y detección de secretos

- Detección de amenazas mediante IA por agencia (familia Assist) con Developer Assist, Triage Assist y Remediation Assist que funcionan de forma autónoma en todo el SDLC

- ASPM empresarial con priorización de vulnerabilidades basada en el riesgo que agrega y correlaciona las señales de todas las herramientas de prueba

- Implementación remota y local para industrias reguladas con un control total de la infraestructura

- Integración profunda de CI/CD con la mayoría de las principales herramientas de canalización

Pros

- La cobertura de escaneo más amplia de cualquier plataforma aquí. Si necesita una herramienta que abarque el código, las API, los contenedores y la infraestructura, ¡esta es la herramienta

- Probado a escala empresarial con carteras de aplicaciones complejas y multilingües

- La opción de despliegue en espacios aislados es muy importante para la defensa, las finanzas y la atención médica

- Los nuevos agentes de Assist llevan la remediación autónoma a una plataforma que ya era integral

Contras

- Conseguir que Checkmarx funcione correctamente en una organización grande requiere un esfuerzo dedicado. La complejidad de la configuración es real

- En esencia, es una plataforma de escaneo. Sin control de herramientas de inteligencia artificial, sin modelos de enrutamiento, sin controles de MCP

- Los precios se basan en cotizaciones y, por lo que he visto en las conversaciones del sector, reflejan cuánto cubren. Esta no es una herramienta que se evalúe durante un fin de semana

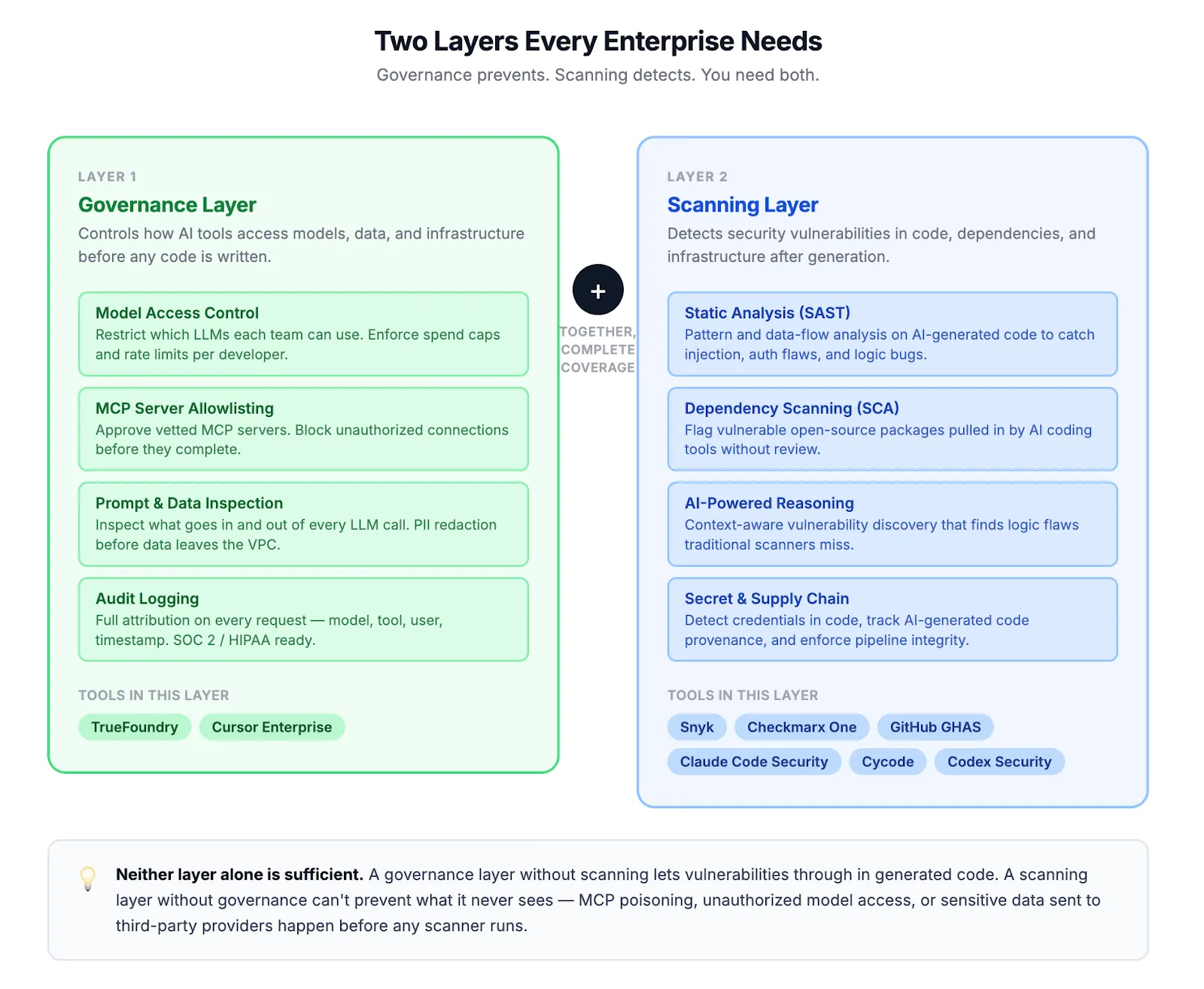

Cómo elegir la herramienta de seguridad de código de IA adecuada

No todas las herramientas de esta lista resuelven el mismo problema, y elegir la incorrecta significa que estás escaneando código que no debería haberse generado de esa manera en primer lugar o controlar el acceso a las herramientas mientras las vulnerabilidades pasan desapercibidas. Es probable que tu equipo se ocupe de alguna combinación de ambas. Esta es una lista de verificación rápida:

- ¿Controla el acceso a las herramientas de IA o simplemente escanea la salida? Si sus ingenieros usan Claude Code, Cursor y Copilot indistintamente, necesita gobernar en la capa de herramientas, no solo escanear en la capa de relaciones públicas.

- ¿Puede controlar las conexiones del servidor MCP? Los agentes de IA ahora se comunican con las bases de datos y las API internas a través de MCP. Si su herramienta de seguridad ni siquiera sabe que el MCP existe, le falta una superficie de ataque cada vez mayor.

- ¿Funciona en toda su cadena de herramientas? Una solución que solo cubre un IDE o un host de código deja huecos cuando los desarrolladores cambian de herramienta.

- ¿Puede hacer cumplir los presupuestos y los límites de tarifas? El gasto desbocado en IA también es un problema de seguridad. La gobernanza de los costes y la gobernanza del acceso suelen pertenecer a la misma plataforma.

- ¿Soporta la implementación local o de VPC? Para las industrias reguladas, las herramientas exclusivas de SaaS suelen ser infructuosas. El código y las instrucciones no deberían salir de la infraestructura.

- ¿Proporciona pistas de auditoría? El SOC 2, la HIPAA y la Ley de IA de la UE exigen una gobernanza demostrable sobre los sistemas de IA. Si no puedes mostrar quién usó qué modelo y qué datos se enviaron, tienes una brecha de cumplimiento.

- ¿Puede detectar vulnerabilidades específicamente en el código generado por IA? Las herramientas SAST tradicionales no se diseñaron para patrones generados por IA. Las herramientas que comprenden el comportamiento de codificación de la IA son más útiles.

- ¿Está diseñado para el rumbo de la industria? Los agentes de codificación de IA son cada vez más autónomos. Sus herramientas de seguridad deben seguir el ritmo de los agentes que ejecutan comandos de shell, llaman a herramientas y abren relaciones públicas sin necesidad de revisión humana.

Los equipos que operan a gran escala suelen necesitar ambas cosas: una capa de gobierno como TrueFoundry para controlar la forma en que las herramientas de IA interactúan con su infraestructura, y herramientas de escaneo como Snyk, Claude Code Security o Checkmarx para detectar lo que se les escapa.

La seguridad del código de IA ya no es opcional

Esta es la realidad de 2026: la IA ya no ayuda al desarrollo. Lo impulsa. Los ingenieros de las empresas más grandes del mundo han entregado una parte importante de su flujo de trabajo a los agentes de inteligencia artificial que leen las bases de código, ejecutan comandos y envían código de forma autónoma. Eso no se está ralentizando.

Las herramientas de seguridad no han seguido el ritmo. La mayoría de las organizaciones siguen intentando proteger el código generado por IA con las mismas herramientas de análisis estático que han utilizado durante una década. Estas herramientas nunca se diseñaron para un mundo en el que un agente de inteligencia artificial se conecta a un servidor MCP no verificado, extrae una dependencia no revisada y compila un código que parece correcto pero no es seguro.

Las organizaciones que se adelanten a esto serán las que combinen la gobernanza y la detección: controlando la forma en que las herramientas de inteligencia artificial acceden a los modelos, la infraestructura y los datos en la fuente, al tiempo que analizan los resultados en busca de las vulnerabilidades que inevitablemente se filtran.

Preguntas frecuentes

¿Qué son las herramientas de seguridad de código de IA?

Las herramientas de seguridad de código de IA ayudan a las organizaciones a detectar y prevenir las vulnerabilidades de seguridad introducidas por el desarrollo asistido por IA. Esto incluye analizar el código generado por la IA en busca de fallos, controlar a qué modelos y herramientas de IA pueden acceder los desarrolladores, controlar la forma en que los agentes de IA interactúan con la infraestructura a través de los servidores MCP y mantener registros de auditoría para garantizar su cumplimiento. Algunas herramientas se centran en el escaneo (Snyk, Checkmarx), otras en la gobernanza (TrueFoundry) y otras en el descubrimiento profundo de vulnerabilidades (Claude Code Security, Codex Security).

¿Cuál es la mejor herramienta de seguridad de código de IA para empresas?

Depende de cuál sea su mayor riesgo. Para las organizaciones que utilizan varias herramientas de codificación de IA y necesitan una gobernanza centralizada, TrueFoundry proporciona el control más amplio a través de sus puertas de enlace de IA y puerta de enlace MCP. Snyk y Checkmarx ofrecen una cobertura sólida si su principal preocupación es escanear el código generado por la IA. Por lo que respecta al descubrimiento de vulnerabilidades, Claude Code Security y OpenAI Codex Security utilizan el razonamiento de la inteligencia artificial para encontrar los problemas que los escáneres tradicionales no detectan. La mayoría de las empresas necesitan una combinación de herramientas de gestión y análisis.

¿Cómo introducen las herramientas de codificación de IA los riesgos de seguridad?

Las herramientas de codificación de IA como Claude Code, Cursor y GitHub Copilot funcionan con privilegios de nivel de desarrollador. Pueden leer archivos, ejecutar comandos de shell, conectarse a bases de datos y API a través de servidores MCP y enviar código a los repositorios. Los riesgos de seguridad surgen cuando estas herramientas se conectan a servidores MCP no verificados, generan código con vulnerabilidades, incorporan dependencias no revisadas o envían datos confidenciales a proveedores de LLM externos. Según la investigación de Veracode de 2025, la IA introdujo vulnerabilidades en el 45% de las tareas de codificación probadas. El análisis estático tradicional no detecta la mayoría de estos riesgos porque la amenaza está en el flujo de trabajo, no solo en el código.

¿Cómo asegura TrueFoundry el desarrollo asistido por IA?

TrueFoundry implementa un AI Gateway y un MCP Gateway dentro de su propia cuenta en la nube (AWS, GCP o Azure) para interceptar y controlar todo el tráfico de codificación de IA. Controla a qué modelos pueden acceder los desarrolladores, impone límites presupuestarios y de tarifas por equipo, permite incluir en listas los servidores MCP aprobados, aplica barreras con comprobaciones previas a la ejecución y validaciones posteriores a la ejecución, y captura los registros de auditoría completos que se pueden exportar a través de OpenTelemetry. Como todo se ejecuta en su VPC, el código y las instrucciones nunca salen de su infraestructura, lo que la hace adecuada para organizaciones con requisitos estrictos de residencia y cumplimiento de datos en virtud del SOC 2, la HIPAA y la Ley de IA de la UE.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)