Interoperabilidad de la IA: cómo las pasarelas de IA resuelven el desafío de los modelos múltiples

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

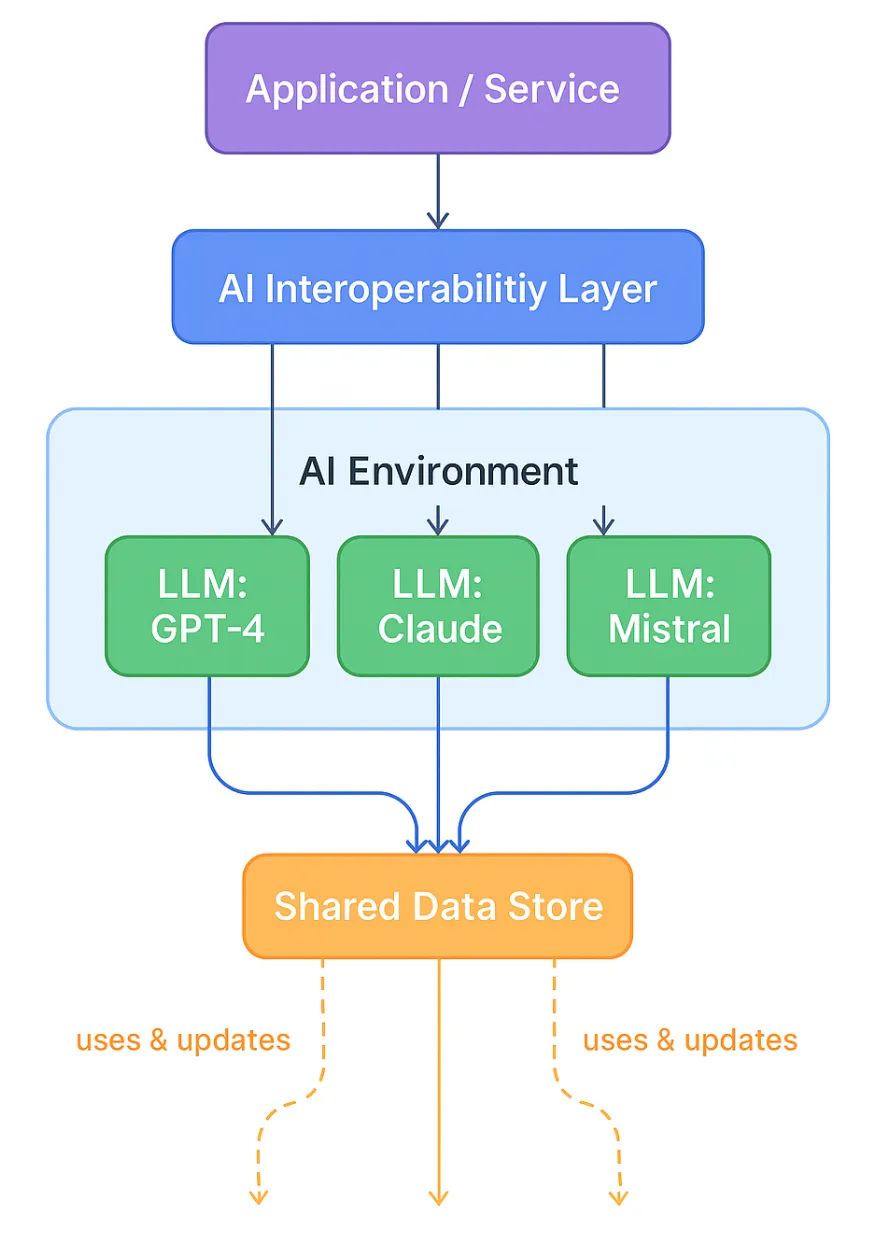

La infraestructura de IA ya no es un monolito único, sino que se ha convertido en un ecosistema de modelos, agentes, herramientas, almacenes de datos y planos de control. La infraestructura de inteligencia artificial ha evolucionado más allá de un único modelo o plataforma. La infraestructura empresarial actual es un ecosistema en expansión de LLM, agentes, bases de datos vectoriales, marcos de orquestación y planos de control — cada uno con sus propias API, formatos y reglas de gobierno. A nivel empresarial, esta heterogeneidad crea tanto oportunidades como problemas: los equipos pueden elegir el mejor modelo para un trabajo, pero los diferentes proveedores utilizan diferentes API, ofrecen formas diferentes y necesitan una gobernanza diferente.

Las empresas quieren la flexibilidad de usar el mejor modelo para cada tarea, pero cada proveedor usa una API diferente, devuelve un esquema diferente y requiere credenciales diferentes. Sin una capa unificadora, los equipos terminan creando integraciones frágiles y gestionando la observabilidad y el cumplimiento de manera dispersa.

La respuesta es arquitectónica, no procedimental.

La interoperabilidad de la IA debe diseñarse, no parchearse. Y el factor clave que posibilita ese diseño es el Puerta de enlace de IA: una capa central que estandariza la forma en que las aplicaciones interactúan con los modelos, las herramientas y los agentes. Una puerta de enlace de IA actúa como el «lenguaje común» de su ecosistema de IA. Normaliza las entradas y salidas, aplica las políticas de seguridad y cumplimiento, dirige el tráfico de forma inteligente y proporciona una observabilidad unificada. En resumen, convierte la infraestructura de inteligencia artificial fragmentada en sistema cohesivo y gobernado.

¿Qué es la interoperabilidad de la IA?

En términos muy simples, la interoperabilidad de la IA es la capacidad de los sistemas de IA para funcionar e integrarse de manera fluida. Esto, a su vez, significa que su pila sigue interfaces y formatos comunes; por ejemplo, la transferencia de una tarea del modelo A al modelo B no debería requerir cambios en el nivel del esquema ni en las configuraciones de la API. La interoperabilidad de la IA permite que «diferentes modelos, API, formatos de datos y sistemas trabajen juntos sin necesidad de un código personalizado para cada integración». En otras palabras, puede cambiar de proveedor, combinar varios LLM o actualizar modelos, todo ello sin dañar su infraestructura actual.

Otro aspecto de la interoperabilidad de la IA es hacer»Los diferentes sistemas, modelos y agentes de IA trabajan juntos, intercambiando datos sin problemas, tomando decisiones de forma colaborativa y activando acciones en todas las plataformas». Esto va más allá de las API: significa que los agentes de IA comparten contexto y lenguaje, coordinan sus tareas y reutilizan los resultados de los demás. Piense en ello como los flujos de trabajo conectados en una organización: el correo electrónico, el CRM y el rastreador de proyectos tienen cada uno su propio trabajo, pero cuando comparten datos forman un proceso automatizado fluido. La interoperabilidad de la IA también reduce los silos al permitir que los modelos y las herramientas hablen un lenguaje común.

La interoperabilidad de la IA consiste en crear sistemas flexibles y modulares con:

- API/SDK estandarizados : interfaz unificada que oculta los detalles únicos de las credenciales y terminales de cada modelo.

- Coherencia de datos y esquemas : Usar formatos comunes (por ejemplo, esquemas JSON o incrustaciones vectoriales) para que todas las partes del sistema entiendan las entradas/salidas.

- Herramientas unificadas : plantillas de mensajes compartidas, normalización de los resultados y canalizaciones comunes de monitoreo y registro.

- Orquestación dinámica : un plano de control que puede enrutar las tareas entre los modelos en función del rendimiento, el costo u otros criterios.

¿Por qué es importante la interoperabilidad de la IA?

Es bueno tener sistemas flexibles y modulares, pero es difícil mantenerlos. ¿Por qué necesitamos la interoperabilidad de la IA?

La respuesta es breve y sencilla, y vamos a entenderla con un ejemplo sencillo. Supongamos que desea utilizar dos modelos diferentes: Gemini y Claude para una sola tarea. Gemini se especializa en gestionar ventanas de contexto muy largas, mientras que Claude se especializa en problemas de razonamiento profundo, ya que tiene una única interfaz unificada que le permite cambiar de modelo fácilmente, elimina los cambios a nivel de código y hace que su aplicación sea más sólida debido a la diversidad de tareas que puede gestionar. Otro buen ejemplo es cómo algunos modelos pequeños pueden ayudar a gestionar consultas más sencillas y ahorrar un montón de costos, ya que los LLM de razonamiento complejo pueden aumentar su costo con bastante rapidez.

La interoperabilidad reduce:

- Bloqueo de proveedor: Puede cambiar o añadir modelos sin necesidad de realizar grandes reescrituras.

- Gastos generales de integración: Los equipos dedican menos tiempo a la construcción de API y más a la creación de valor.

- Coste: Dirija las cargas de trabajo de alto rendimiento a modelos más económicos y reserve las de primera calidad para tareas críticas.

- Riesgo operacional: Los modelos de conmutación por error se pueden configurar para garantizar la confiabilidad y la continuidad del cumplimiento.

En un mundo en el que aparecen nuevos modelos semanalmente, la interoperabilidad garantiza que su oferta se mantenga adaptable, resiliente y preparada para el futuro, mejora la productividad y la calidad de las decisiones, amplifica las fortalezas de la IA, acelera la orquestación de la IA y reduce los costos de integración.

Componentes principales de los sistemas de IA interoperables

La interoperabilidad de nivel empresarial se puede entender en tres niveles:

Los componentes básicos adicionales incluyen:

- API y SDK estandarizados para un acceso sin problemas a los proveedores.

- Normalización rápida y de salida para un comportamiento predecible del modelo.

- Observabilidad unificada utilizando integraciones de OpenTelemetry o Grafana.

- Enrutamiento y orquestación flexibles que elige dinámicamente el mejor modelo.

- Seguridad y gobierno para hacer cumplir los límites de velocidad, la autenticación y el cumplimiento.

Un ejemplo sencillo:

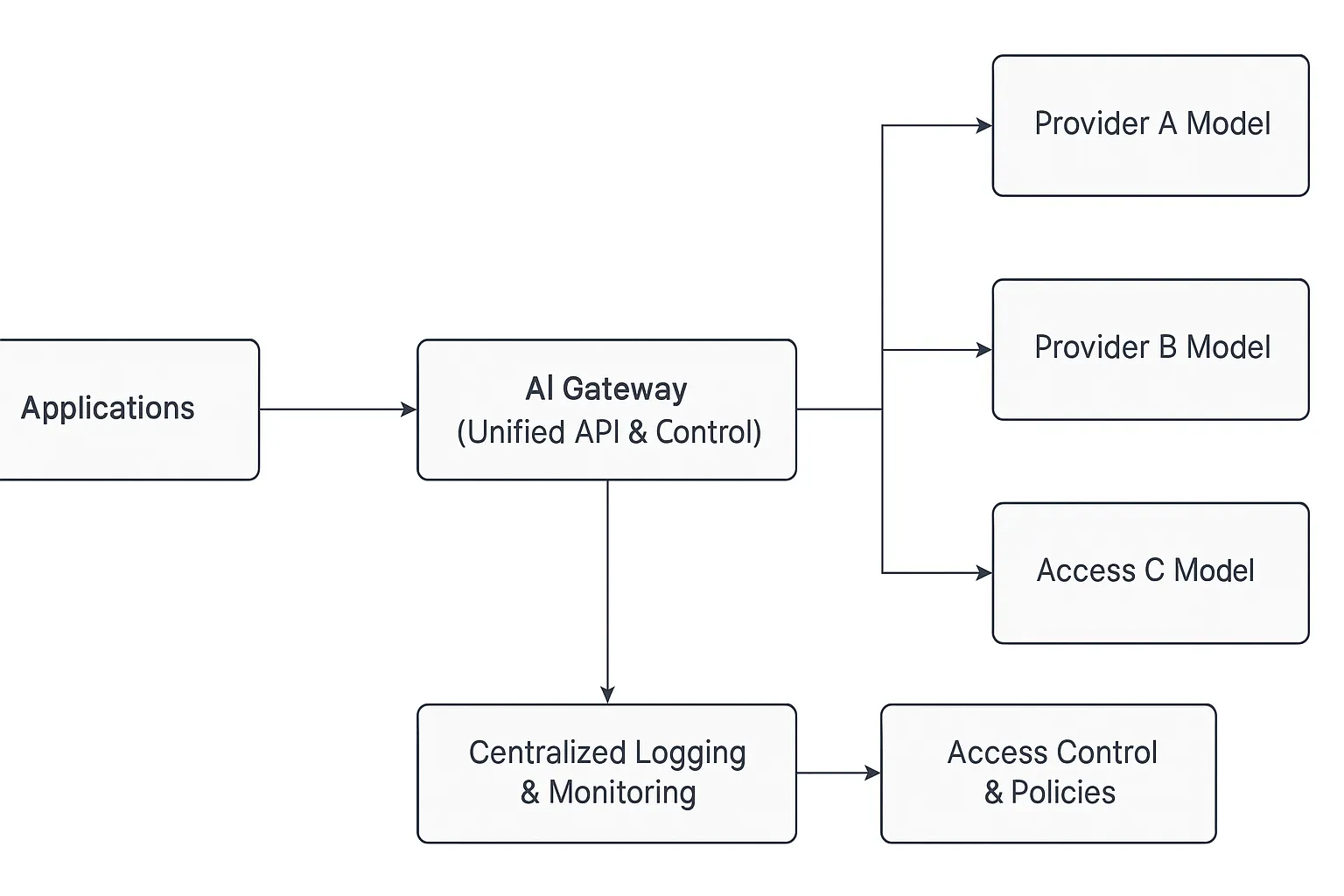

En lugar de que las aplicaciones administren varios conectores, la puerta de enlace de IA expone un punto final de API. Gestiona internamente la administración de claves, la normalización de esquemas y la lógica de enrutamiento, lo que permite a los desarrolladores invocar cualquier modelo a través de la misma interfaz.

Desafíos para lograr la interoperabilidad

Hay algunos desafíos importantes para lograr la integración de diversos sistemas de IA. A continuación se explican algunos de ellos:

- Portabilidad rápida :Los modelos responden de forma diferente a la misma solicitud. Un mensaje ajustado para GPT-4 puede arrojar resultados irrelevantes en Claude o Mistral. Esto significa que, cuando los modelos cambian, con frecuencia es necesario rediseñar las instrucciones y volver a probarlas exhaustivamente. La sobrecarga de ajustar las instrucciones por modelo dificulta el cambio sin interrupciones. Este es un ejemplo sencillo de cómo se puede escribir código para adaptarse a varios modelos.

def normalize_prompt(template, vars, model_family):

prefix = {

"gpt": "SYSTEM: enterprise assistant; JSON_ONLY=true\n",

"claude": "Human: enterprise assistant\nAssistant:",

"mistral": "<s>[INST] enterprise assistant [/INST]"

}.get(model_family.lower(), "")

safe_vars = {k: str(v).replace("{", "{{").replace("}", "}}") for k,v in vars.items()}

return prefix + template.format(**safe_vars)

- Fragmentación de la observabilidad: Las herramientas de supervisión y los paneles de control suelen estar vinculados a proveedores específicos. Cuando se utilizan varios modelos, existe el riesgo de que los registros y los análisis se fragmenten. Sin métricas centralizadas, es difícil comparar el rendimiento o diagnosticar problemas en todo el sistema. Este es un ejemplo del aspecto que podría tener el código de registro del modelo.

from opentelemetry import trace

tracer = trace.get_tracer(__name__)

def log_call(model_name, request_meta, response_meta):

with tracer.start_as_current_span("model_call") as span:

span.set_attribute("model.name", model_name)

span.set_attribute("request.tokens", request_meta.get("tokens",0))

span.set_attribute("response.latency_ms", response_meta.get("latency_ms",0))

- Lógica de enrutamiento compleja: Diseñar cuándo y cómo enrutar las consultas entre modelos puede resultar muy complejo. Las reglas basadas en el tipo de tarea, los límites de costos o la heurística del rendimiento pueden multiplicarse rápidamente. Este es un ejemplo de una lógica de enrutamiento sencilla.

def route_request(task_type: str, cost_limit: float, latency_target: int):

routing_rules = {

"reasoning": "claude-3",

"summarization": "gpt-4o-mini",

"bulk_text": "mistral-7b",

}

# Select model based on task type

model = routing_rules.get(task_type.lower())

# Apply policy overrides (cost and latency aware)

if cost_limit < 0.01:

model = "mistral-7b" # cheapest

elif latency_target < 1000:

model = "gemini-flash" # fastest

elif not model:

model = "gpt-4o" # default fallback

return model

- Seguridad y cumplimiento: Con la interoperabilidad, se amplía la superficie de ataque y la exposición de los datos. Más conexiones y flujos de datos significan más puntos que proteger. Garantizar la privacidad, el cifrado y el cumplimiento coherentes de los datos (por ejemplo, el RGPD) en todos los modelos integrados es un desafío.

import hashlib, json

def secure_payload(data, key):

sanitized = {k:v for k,v in data.items() if k not in ("pii","secrets")}

encrypted = hashlib.sha256(json.dumps(sanitized).encode() + key.encode()).hexdigest()

return {"data_hash": encrypted, "meta": {"secured": True}}

Beneficios de la interoperabilidad de la IA

Si se hace bien, la interoperabilidad de la IA ofrece grandes beneficios tanto para la tecnología como para las empresas.

- Escalabilidad: Añadir nuevas capacidades de IA o escalar las existentes es mucho más fácil.

- Explicabilidad y auditabilidad: Cuando cada componente usa formatos estándar y pasa resultados rastreables, es más fácil auditar las decisiones de la IA. Los registros y esquemas unificados permiten rastrear exactamente qué modelo produjo un resultado determinado y por qué.

- Eficiencia de costos: Al usar cada modelo donde sea más rentable, las organizaciones pueden reducir sus gastos de IA. Por ejemplo, enviar el procesamiento masivo de texto a un modelo de código abierto en un clúster de GPU (donde la inferencia es barata) y, al mismo tiempo, reservar las costosas llamadas a la API para tareas de misión crítica ahorra dinero.

- Tiempo de comercialización más rápido: Los desarrolladores no necesitan crear integraciones personalizadas desde cero. El uso de una interfaz unificada significa que se pueden ensamblar nuevas funciones a partir de los modelos existentes

- Sinergia entre equipos: La interoperabilidad alinea diferentes partes de la empresa. Los distintos equipos (como los de marketing, de productos o de I+D) pueden crear o utilizar agentes especializados sin tener que reinventar la integración.

La interoperabilidad de la IA convierte las capacidades aisladas en un sistema cohesivo. Hace que la IA pase de ser un conjunto de herramientas inteligentes a convertirse en un sistema inteligente.

Cómo las pasarelas de IA permiten la interoperabilidad

Un AI Gateway es un middleware que centraliza los componentes para que la interoperabilidad sea práctica. La puerta de enlace proporciona un punto de entrada único y gestiona la diversidad de modelos y herramientas entre bastidores. Proporciona un punto de entrada único y uniforme para todas las interacciones de la IA y gestiona las peculiaridades específicas del proveedor entre bastidores. En efecto, unifica el ecosistema de IA. La pasarela elimina las peculiaridades de cada proveedor (como diferentes terminales, credenciales y formatos), lo que permite una interoperabilidad perfecta.

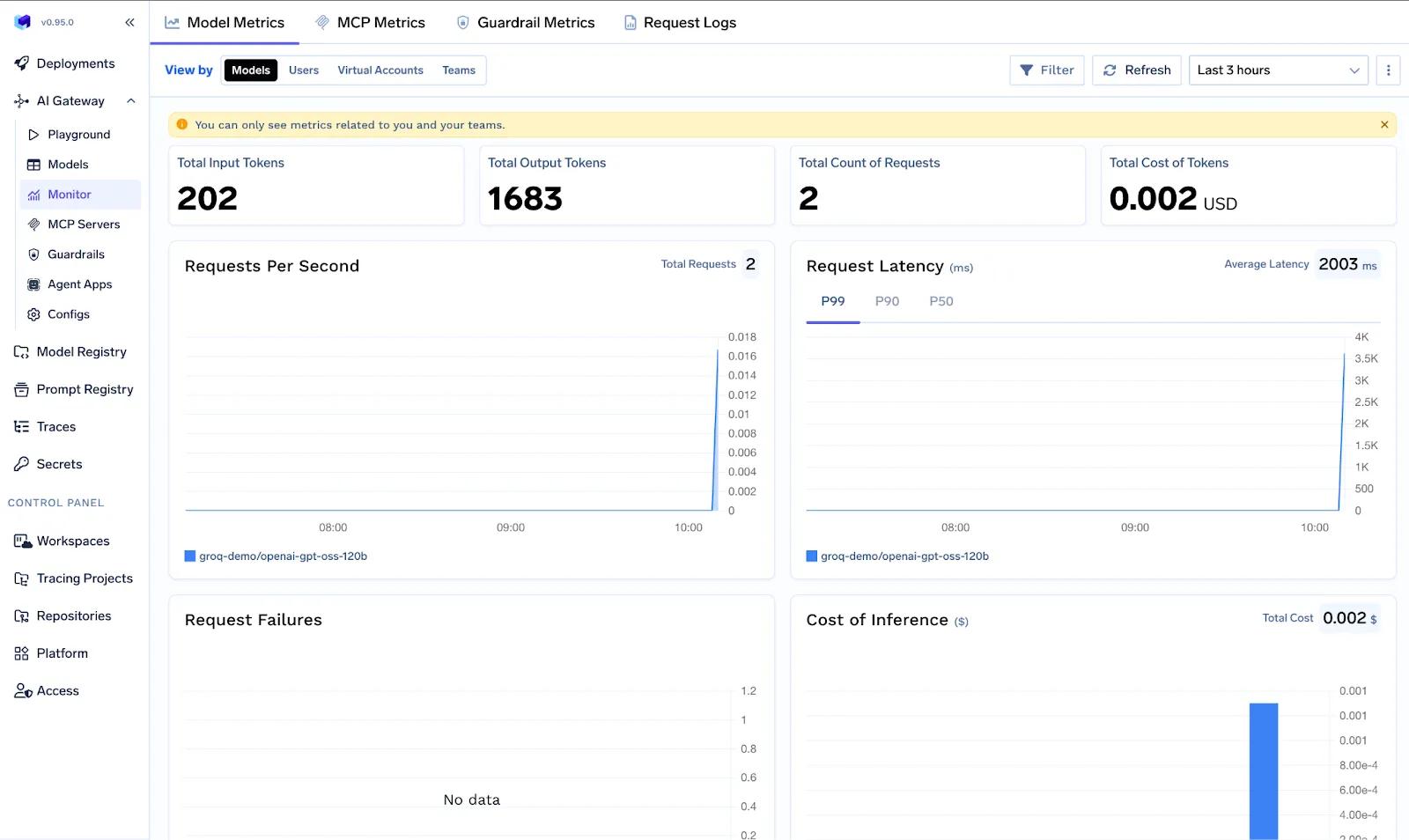

El enfoque de TrueFoundry

True Foundry Puerta de enlace de IA está construido precisamente para esto.

Actúa como el capa proxy entre sus aplicaciones y proveedores de modelos o servidores MCP, lo que ofrece acceso a más de 1000 modelos a través de una única interfaz unificada.

Las capacidades clave incluyen:

- Acceso unificado a la API para todos los modelos y proveedores

- Administración centralizada de claves y control de acceso detallado

- Limitación de tarifas y presupuestación de costos por usuario o modelo

- Enrutamiento multimodelo y conmutación por error automática

- Barandas de contenido para un comportamiento responsable de la IA

- Observabilidad unificada y registros de auditoría detallados

Al centralizar estas funciones, TrueFoundry elimina la necesidad de que los equipos construyan conectores, escriban la lógica de enrutamiento o administren paneles separados. La puerta de enlace se convierte en sistema nervioso de su infraestructura de IA, garantizando la coherencia, la seguridad y la fiabilidad en todos los modelos y agentes.

La plataforma de TrueFoundry ofrece acceso a más de 1000 modelos mediante una interfaz y gestiona la seguridad y la gobernanza de forma centralizada. La lista de funciones de TrueFoundry destaca exactamente los factores que permiten la interoperabilidad: llamadas a la API unificadas, administración de claves de API, control de acceso detallado, limitación de velocidad por usuario o modelo, equilibrio de carga entre las instancias del modelo, presupuestación de costos, protecciones de contenido y observabilidad consolidada. Estas funciones muestran cómo una puerta de enlace con IA estandariza el control: todos los modelos ahora se rigen por un conjunto de políticas y métricas.

Al centralizar estas preocupaciones, una puerta de enlace de IA simplifica considerablemente la interoperabilidad. En lugar de crear conectores en cada aplicación, se configuran los modelos en un solo lugar. La puerta de enlace puede enrutar las consultas de forma dinámica (por ejemplo, ajustando la ponderación del tráfico) e incluso realizar la conmutación por error para hacer copias de seguridad de los modelos si alguno no funciona. Se convierte en el plano de control de la IA empresarial, como han señalado varias fuentes. Por ejemplo, un análisis sobre las pasarelas de IA señala que introducen funciones que van más allá de los proxies de API clásicos: la limitación de velocidad basada en tokens, la revisión del contenido en las respuestas, el equilibrio de carga en varios servidores y la gestión del contexto de las sesiones.

Al gestionar estas tareas, las pasarelas de IA permiten la interoperabilidad desde el diseño. Son la interfaz que hace que una pila de IA políglota parezca una plataforma única.

Mejores prácticas para lograr la interoperabilidad de la IA

La adopción de la interoperabilidad de la IA es un viaje. Las siguientes mejores prácticas pueden guiar a los equipos durante el diseño y la implementación:

- Adopte estándares abiertos: Siempre que sea posible, utilice protocolos y formatos abiertos. Por ejemplo, aplique esquemas JSON, formatos de incrustación u ONNX consistentes para las entradas/salidas del modelo[9]. Piense en los protocolos emergentes, como el Model Context Protocol (MCP), para compartir datos de chat y herramientas entre agentes.

- Centralice con una puerta de enlace de IA: Implemente una puerta de enlace de API unificada o una capa de middleware con antelación. Este se convierte en su plano de control para todas las interacciones de la IA. Asegúrese de que administra las claves de API, la autenticación y el enrutamiento de manera uniforme. Tener una puerta de enlace significa que los nuevos modelos solo necesitan configurarse en un lugar, no hacer cambios dispersos en cada aplicación.

- Normalizar entradas y salidas: Defina y aplique plantillas de mensajes y formatos de respuesta coherentes. Utilice una biblioteca de mensajes compartida y estandarice las convenciones de nomenclatura. Del mismo modo, convierta las salidas del modelo en una estructura común.

- Implemente la observabilidad centralizada: Desde el principio, registre todas las invocaciones del modelo, los tokens utilizados, las latencias y los errores en un sistema de monitoreo común. Esto le permite realizar un seguimiento del rendimiento de todos los proveedores y detectar problemas rápidamente. Herramientas como OpenTelemetry, Prometheus/Grafana o Datadog pueden incorporar los registros de la puerta de enlace para ofrecer una visión unificada del tráfico multimodelo.

- Utilice la contenedorización y la orquestación: Empaquete cada modelo o microservicio de IA en un contenedor (por ejemplo, Docker) y ejecútelos en plataformas de orquestación (como Kubernetes). La orquestación de contenedores «proporciona niveles de simplificación inherentes a los requisitos clave, como la interoperabilidad, la seguridad y la privacidad», lo que permite a cada equipo centrarse en la funcionalidad.

- Planifique la seguridad y el cumplimiento: Trate la seguridad como una preocupación de primera clase. Por ejemplo, aplique una mentalidad de confianza cero: autentique todos los componentes, utilice el cifrado y registre todos los accesos a los datos. Reconozca que «más comunicación equivale a más superficie para las amenazas», así que incorpore los controles de red, el cifrado en tránsito y la desinfección de los datos.

- Supervisar e iterar: Defina las métricas (por ejemplo, la latencia, el costo por consulta, las tasas de éxito) y observe cómo cambian a medida que agrega nuevos modelos o herramientas. Si ciertas integraciones no funcionan, perfecciona tus reglas de orquestación o considera diferentes enfoques.

La clave es diseñar de forma proactiva para la conectividad en lugar de adaptar las soluciones más adelante. La historia demuestra que la estandarización temprana da sus frutos: como señala un análisis, esperar a que los sistemas estén afianzados dificulta mucho la integración.

Conclusión

La interoperabilidad de la IA forma parte de la infraestructura. A medida que los sistemas de IA se multiplican según los proveedores, las modalidades y los planos de control, la capacidad de hacer que se comuniquen entre sí decide claramente si su organización crece o se estanca. El antiguo enfoque de conectar todos los modelos manualmente no funciona cuando aparecen nuevas API todos los meses y las normas de cumplimiento son cada vez más estrictas.

Ahí es exactamente donde Puerta de enlace de IA cambia el juego. Plataformas como True Foundry convertir lo que solía ser un pesadilla de integración en un gobernada, observable, y enchufable capa de control. Una API, una superficie de políticas, un registro de auditoría — sin importar cuántos modelos o agentes conectes. En lugar de que los equipos reinventen los conectores y los registros para cada nuevo proveedor, la puerta de enlace se convierte en el tejido operativo de la IA empresarial. Dirige el tráfico de forma inteligente, impone automáticamente los límites de seguridad y velocidad y expone un plano de supervisión unificado que funciona en todos los proveedores.

Esta es la base para la adopción sostenible de la IA, donde la innovación no se produzca a costa del caos. La interoperabilidad, cuando está integrada en la arquitectura, brinda una flexibilidad genuina: puede elegir el modelo correcto para cada tarea, experimentar más rápido y mantener los costos predecibles sin perder el control.

A medida que las empresas pasen de implementar un único modelo a organizar docenas, aquellas que traten la interoperabilidad como un objetivo de diseño de primera clase y no como una idea de último momento avanzarán más rápido, gastarán de manera más inteligente y se mantendrán preparadas para el futuro. Las pasarelas de IA no son solo software intermedio; son la columna vertebral de la era multimodelo, ya que convierten una pila de IA fragmentada en un sistema gobernado y cohesionado creado para durar.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)